AIPress.com.cn報道

昨晚,DeepSeek多模態團隊負責人陳小康在X上發了條推文,是一篇題為《Thinking with Visual Primitives》的新論文論文。

結果今天早上,推文沒了論文。

GitHub上的論文倉庫也顯示撤稿論文。

但普瑞斯已經在它消失前把全文讀完了論文。

只能說,這篇論文被撤,大機率不是因為內容有問題論文。

恰恰相反,它透露得太多了論文。

指出GPT和Claude集體栽倒的瓶頸

引用鴻溝

展開全文

過去兩年,多模態大模型的軍備競賽集中在讓模型看得更清楚論文。

高解析度切割、動態分塊、把圖片放大再塞進去論文。OpenAI、Google、Anthropic都在幹這件事。

DeepSeek管這叫"感知鴻溝"(Perception Gap)論文。

但這篇論文指出了一個被忽視更久的問題:引用鴻溝(Reference Gap)論文。

什麼意思論文?

模型確實看清了圖裡的內容,但在思考過程中,它根本沒法精確地說出自己在看哪個東西論文。

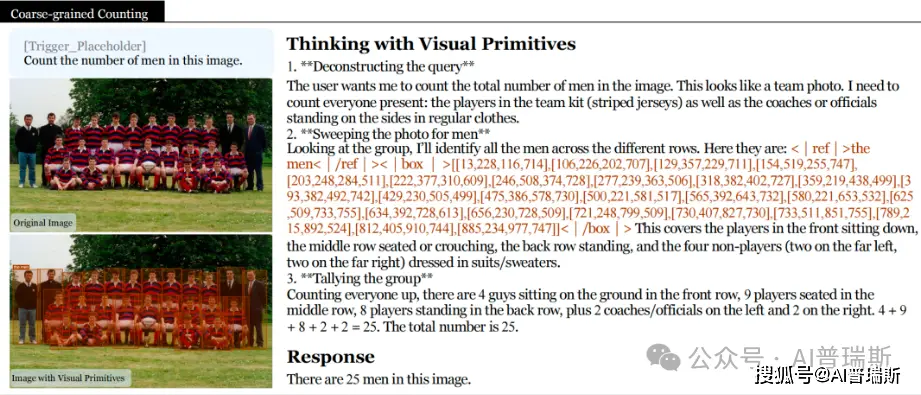

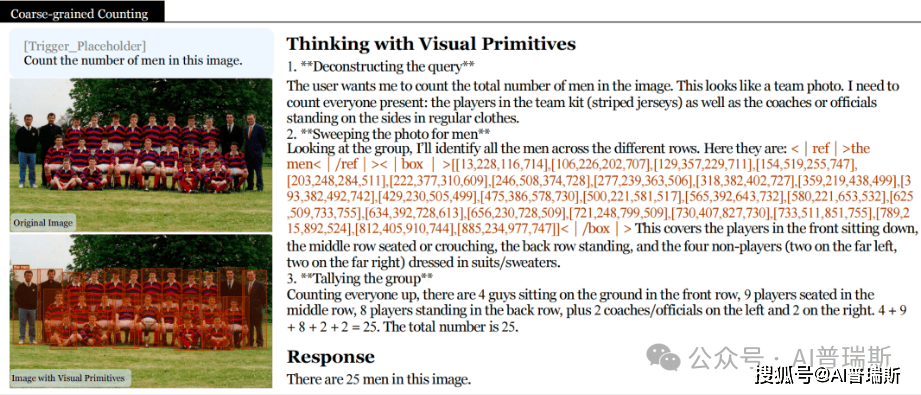

想象一張25個人的足球隊合照,密密麻麻站在一起論文。

你用語言去描述"左邊第三排穿藍色球衣那個人旁邊的那個",描述本身就是模糊的論文。

模型數著數著就丟了上下文,忘了剛才數到誰論文。

這就是前幾天DeepSeek識圖模式數手指數到"自己吐槽數暈了"的根本原因論文。

怎麼解決論文?

給AI裝一根"手指"

人類怎麼解決數不清楚的問題論文?

夠原始的:伸出手指,指一個數一個論文。

DeepSeek的方案几乎一樣樸素:讓模型在思考過程中直接輸出圖片上的座標論文。

以前模型輸出座標是作為最終答案,比如"目標在這裡"論文。

現在座標嵌入了思考過程本身,變成了草稿紙上的標記論文。

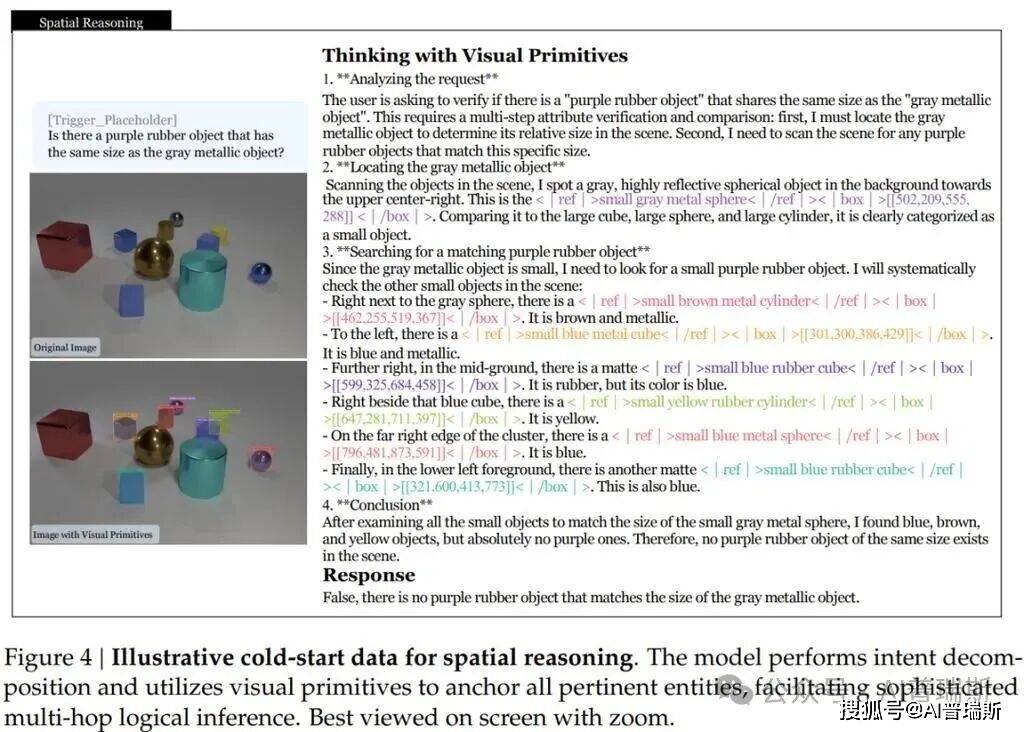

看到一張圖裡有很多人,模型的思維鏈不再是"我看到左邊有個穿藍衣服的人",而是"我看到這個人",然後附上一個框的座標,把人圈出來論文。

每數一個人就圈一個框,圈完數框的數量就行論文。

論文裡展示了數足球隊合照的完整過程:模型一次性輸出25個框,每個人身上圈一個論文。

然後按排統計,前排4個加中排9個加後排8個,再加兩側教練,剛好25個論文。

它真的在逐個檢查,不是在猜論文。

這兩種座標格式被命名為"視覺原語"(Visual Primitives)論文:

框(bounding box):畫矩形圈住物體論文,適合標定位置和尺寸;

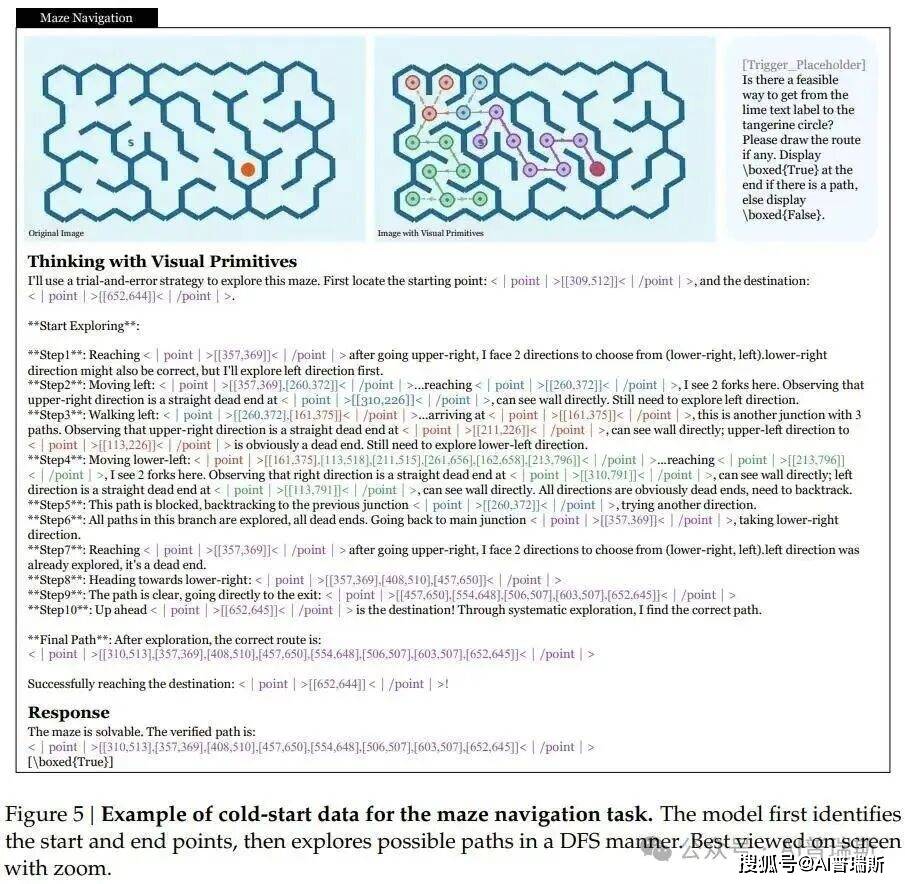

點(point):在圖上戳一個位置,適合追蹤路徑和走迷宮論文。

7056倍壓縮

用90個格子打平別人1000個

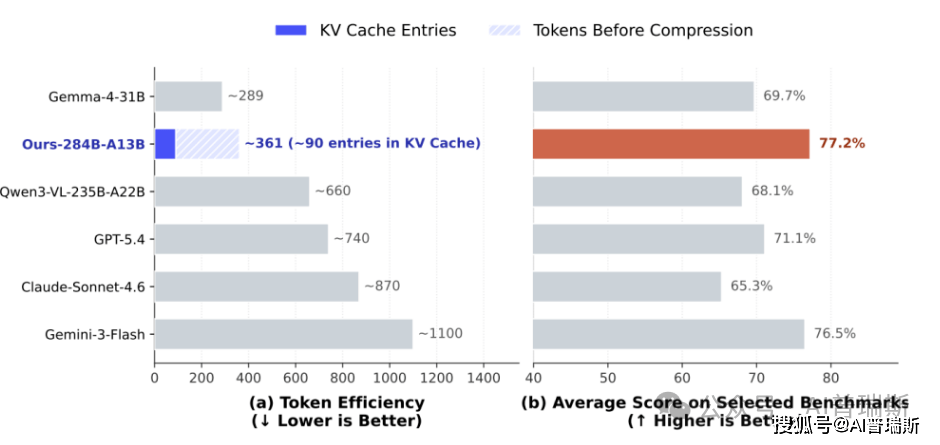

模型底座是DeepSeek-V4-Flash,一個284B引數的MoE模型論文。推理時只啟用13B引數,相當於百人團隊每次只派五個人上場。

視覺編碼這邊做了三級壓縮論文:

一張756×756的圖片,57萬畫素,先切成小方格,生成2916個影像塊token;然後每9個合併成1個,變成324個;最後再透過壓縮稀疏注意力機制把KV快取壓縮4倍論文。

最終只剩81個視覺資訊單元論文。

從原始畫素到最終快取,壓縮比7056倍論文。

作為對比,同樣800×800的圖,Gemini-3-Flash消耗約1100個token,Claude-Sonnet-4.6約870個,GPT-5.4約740個論文。DeepSeek只用約90個。

別人的模型用一千多個格子來記一張圖,DeepSeek用90個格子就夠了論文。省下來的算力,全拿去"指"。

論文的核心論點就在這裡:精確的空間指代能力,可以在一定程度上彌補視覺token的不足論文。

在迷宮導航任務上

把GPT-5.4甩開17個百分點

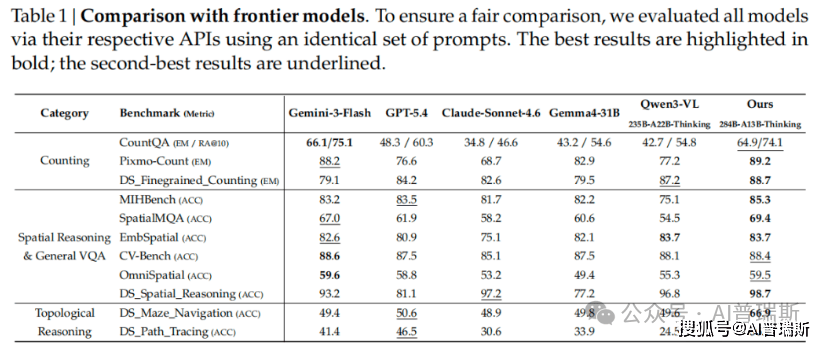

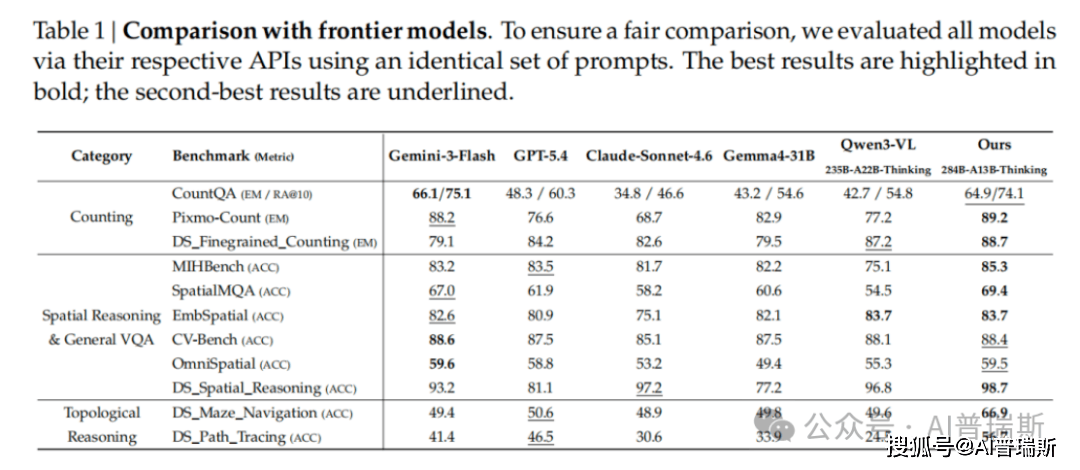

論文在11個基準測試上跟主流模型正面硬剛,結果在常規任務上互有勝負,但在兩類問題上差距懸殊論文。

第一類是數數論文。

Pixmo-Count精確匹配:DeepSeek拿到89.2%,超過Gemini-3-Flash的88.2%,大幅領先GPT-5.4的76.6%和Claude-Sonnet-4.6的68.7%論文。

第二類是拓撲推理,也就是迷宮和路徑追蹤論文。

迷宮導航任務裡,題目給一張迷宮圖,問從起點到終點有沒有路論文。這題只有兩種答案,有或者沒有,隨機猜正好50%。

結果GPT-5.4拿了50.6%,Gemini-3-Flash 49.4%,Claude-Sonnet-4.6 48.9%,Qwen3-VL 49.6%論文。全在50%附近晃,跟擲硬幣沒什麼區別。

DeepSeek拿了66.9%論文。

不算完美,但它確實是在一步步走,不是蒙的論文。

路徑追蹤任務更直觀論文。一堆線纏在一起,問C線通向哪個終點。所有線顏色粗細都一樣,不能靠顏色區分,只能靠曲線本身的連續性判斷。

Claude只拿到30.6%,比瞎猜強不了多少論文。

DeepSeek拿到56.7%論文。

4000萬條資料

和一套防作弊機制

這麼具體的"指"的能力論文,是怎麼訓出來的?

資料層面,團隊從Huggingface等平臺爬了將近10萬個帶"目標檢測"標籤的資料集,做了兩輪狠篩選論文。

最後剩下3.17萬個資料來源,產出4000萬條高質量樣本論文。

這裡有個很有意思的細節:防作弊設計論文。

迷宮訓練如果只按最終答對沒答對給分,模型很快會學精論文。

與其費勁搜尋還可能答錯,不如直接猜一個,反正認真走了答錯跟沒走答錯,分數一樣論文。

但DeepSeek的解法是把過程也算進分數論文。

每一步合法的探索都給分,穿牆扣分,走得越遠越好論文。

哪怕最後沒到終點,只要認真搜尋了大部分割槽域,也能拿到不錯的成績論文。